Unsere vernetzte Welt verstehen

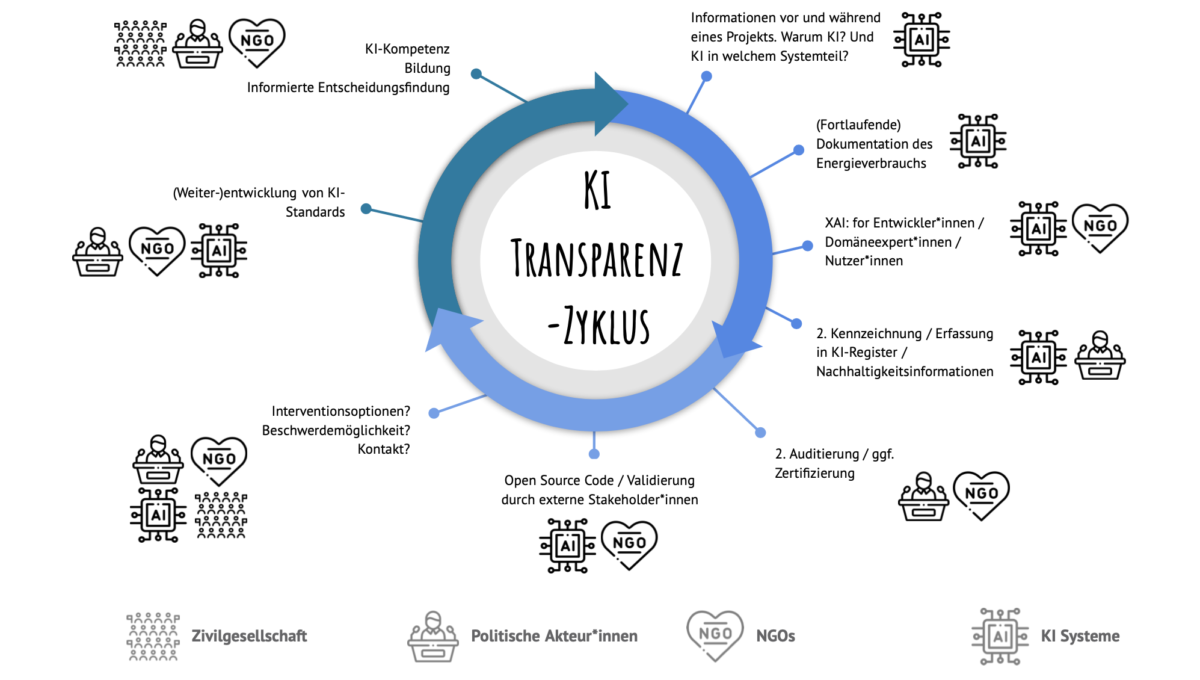

Der KI Transparenz-Zyklus

Warum KI Transparenz?

KI ist allgegenwärtig und unsichtbar zugleich. Bist du dir jedes Mal bewusst, wenn du mit einem Algorithmus interagierst? Weißt du, welche Daten gesammelt und verarbeitet werden, während du nebenbei durch Social Media scrollst oder Produkte in Online-Shops durchstöberst? Datenschutzerklärungen von Plattformanbietern versprechen volle Transparenz, aber was bedeutet das überhaupt und welche Ziele stehen dahinter?

Der Teufel steckt im Detail

Transparenz zu definieren war noch nie einfach und im Zusammenhang von KI-Systemen ist das keine Ausnahme. Im weitesten Sinne ist Transparenz das, was man wahrnehmen und verstehen kann und was einen im Angesicht dieses Wissens handeln lässt. Wenn man bedenkt, dass die Datenschutzerklärungen großer Tech-Firmen weit über 10.000 Wörter umfassen und darauf abzielen, Nutzer*innen über Absichten und Schutzrechte zu informieren, erscheint die Wirksamkeit bestehender Maßnahmen zur KI Transparenz fragwürdig. Verstehst du zum Beispiel, wann du mit einem KI-System in Berührung kommst und warum dir Plattformen bestimmte Inhalte empfehlen? Selbst wenn diese Informationen verfügbar sind, sind sie möglicherweise nicht transparent, weil Verfügbarkeit nicht immer auch Verständlichkeit heißt.

Metaphern der Transparenz

Forschung zur Verwendung der Metapher Transparenz (Ball, 2009) zeigt im Kontext von Nichtregierungsorganisationen und anderen politischen Akteur*innen, dass wir mit Transparenz verschiedene Zwecke der Vermittlung von Informationen meinen. Ball (2009) unterscheidet zwischen drei: Rechenschaftspflicht, Offenheit und Effizienz. Offenheit ist vermutlich das intuitivste Ziel von Transparenz. Offenheit erzwingt Transparenz, um Vertrauen zu schaffen. Sie schafft beispielsweise Vertrauen, indem sie es Betroffenen ermöglicht, zu sehen, was vor anderen geschützt wird, z. B. zum Schutz der eigenen Privatsphäre. Dazu gehört nicht nur die informierte Entscheidungsfindung, sondern auch das Wissen, welche Fragen man überhaupt stellen muss. Effizienz mag als Ziel von Transparenz weniger intuitiv sein, ist aber für heutige komplexe Gesellschaften nicht weniger von Bedeutung. Nur wenn wir komplexe Systeme kennen und verstehen, können wir sicherstellen, dass sie effizient funktionieren, da wir dann nicht jedes Mal, wenn wir auf sie angewiesen sind, ihre Funktionsweise hinterfragen müssen. Deshalb ist Transparenz auch für den gesellschaftlichen Fortschritt wichtig. Schließlich wollen wir uns noch die Rechenschaftspflicht genauer ansehen.

Rechenschaftspflicht

Als drittes wichtiges Ziel der Transparenz wird häufig die Rechenschaftspflicht genannt. Im Hinblick auf KI-Systeme bezieht sich dies auf die Frage, wer für die einzelnen Schritte bei der Entwicklung und Anwendung von Machine-Learning-Algorithmen verantwortlich ist. Mark Bovens, der zu öffentlicher Rechenschaftspflicht forscht, definierte sie „als eine soziale Beziehung, in der ein Akteur sich verpflichtet fühlt, sein Verhalten gegenüber einer anderen Bezugsperson zu erklären und zu rechtfertigen.“ (Bovens, 2005). Er erkennt fünf Merkmale der öffentlichen Rechenschaftspflicht, nämlich 1. öffentlicher Zugang zur Rechenschaftspflicht, 2. proaktive Erklärung und Rechtfertigung von Handlungen, 3. Adressierung eines bestimmten Publikums, 4. eine intrinsische Motivation zur Rechenschaftspflicht (im Gegensatz zu Handeln nur auf Verlangen) und 5. die Möglichkeit der Auseinandersetzung, einschließlich möglicher Sanktionen im Vergleich zu ungefragten Monologen. Insbesondere das vierte Merkmal stellt eine Herausforderung dar, wenn man bedenkt, dass Rechenschaft gemeinhin als ein Instrument zur Vermeidung von Schuldzuweisungen und rechtlichen Konsequenzen angesehen wird. Für eine effektive Umsetzung der Rechenschaftspflicht ist die sorgfältige Umsetzung von KI Transparenz essentiell, damit sie sich nicht „in einen Abfalleimer mit guten Absichten, lose definierten Konzepten und vagen Vorstellungen von guter Managementpolitik entwickelt.“ (Bovens, 2005).

One-size-does-not-fit-all

Transparenz ist ein fortlaufender Prozess – keine unveränderliche Tatsache. Sie muss in ihrem Kontext und aus der Perspektive der betroffenen Akteur*innen betrachtet werden (Lee & Boynton, 2017). Ein großes Unternehmen, das einer Regierungsbehörde Transparenz in Bezug auf seine Software bietet, kann nicht dieselben Erklärungen und Informationen an eine/n Nutzer*in richten und erwarten, dass damit Transparenz geschaffen wird. In gewisser Weise kann ein mehr an Transparenz zu weniger führen, indem eine überwältigende Menge an Informationen dem falschen Empfänger übermittelt wird. Zu den relevanten Faktoren, auf die KI Transparenz zugeschnitten werden muss, gehören das erforderliche Niveau der Transparenz, die politische oder gesellschaftliche Funktion des Systems, die Zielgruppe(n) und die spezifische Funktion der Transparenz. Im Kern geht es dabei um die Notwendigkeit einer informierten Entscheidungsfindung.

KI Transparenz geht jeden etwas an

In der Praxis kann Transparenz nicht von einem/r einzelnen Akteur*in umgesetzt werden, sondern muss sich auf jeden Schritt des Prozesses auswirken. Ein Informatiker ist sich ethischer und rechtlicher Risiken oft nicht bewusst, und beispielsweise ein Jurist kann solche nicht durch das Lesen von Computercodes erkennen. Dies wird besonders bei unabsichtlichen Folgen deutlich, die nicht nur vorausgehende Zertifizierungen, sondern auch regelmäßige Kontrollen und Interventionsmöglichkeiten für Betroffene am Ende der Kette erforderlich machen. Eine häufige Hürde für klare Transparenzstandards in diesem Bereich ergibt sich aus dem Konflikt zwischen dem Schutz von Geschäftsgeheimnissen und der Notwendigkeit, zu Prüfungszwecken Zugang zu Softwarecodes zu erhalten.

Der „KI Transparenz-Zyklus“ (siehe Grafik oben) bietet einen Überblick darüber, wie die vielen Dimensionen der KI-Entwicklung und -Einsatzes und ihre sich ständig verändernde Struktur modellhaft dargestellt werden könnten, und dient als Fahrplan zur Lösung des Rätsels um die KI Transparenz. Es ist dabei wichtig, den Zyklus nicht als chronologische Schritt-für-Schritt-Anleitung zu interpretieren, sondern vielmehr als einen kontinuierlichen, sich selbst optimierenden Feedback-Prozess, in dem Entwicklung, Validierung, Interventionen und Aufklärung durch die beteiligten Akteur*innen parallel stattfinden.

Quellen

Ball, C. (2009). What is Transparency?. Public Integrity, 11, 293-308.

Dieser Beitrag spiegelt die Meinung der Autor*innen und weder notwendigerweise noch ausschließlich die Meinung des Institutes wider. Für mehr Informationen zu den Inhalten dieser Beiträge und den assoziierten Forschungsprojekten kontaktieren Sie bitte info@hiig.de

Jetzt anmelden und die neuesten Blogartikel einmal im Monat per Newsletter erhalten.

Künstliche Intelligenz und Gesellschaft

KI zwischen Klimawandel und Klimaschutz

Wie wirken Klimawandel und Künstliche Intelligenz zusammen? Kann KI bei der Bekämpfung des Klimawandels helfen?

Digital by design, not by default: Resilienz an Hochschulen

Was bedeutet Resilienz an Hochschulen? Ein Vergleich zweier Modelle aus Deutschland und Portugal zeigt: Es gibt keine einheitliche Formel.

Algorithmen unter Beobachtung: KI-Observatorien als demokratische Infrastruktur

Algorithmen greifen in das Leben von Menschen ein. Dieser Artikel zeigt, warum KI-Observatorien für demokratische Kontrolle unverzichtbar sind.