Unsere vernetzte Welt verstehen

Wenn Bots zurückschlagen: KI-Agenten, Verleumdung und die Konstruktion digitaler Identität

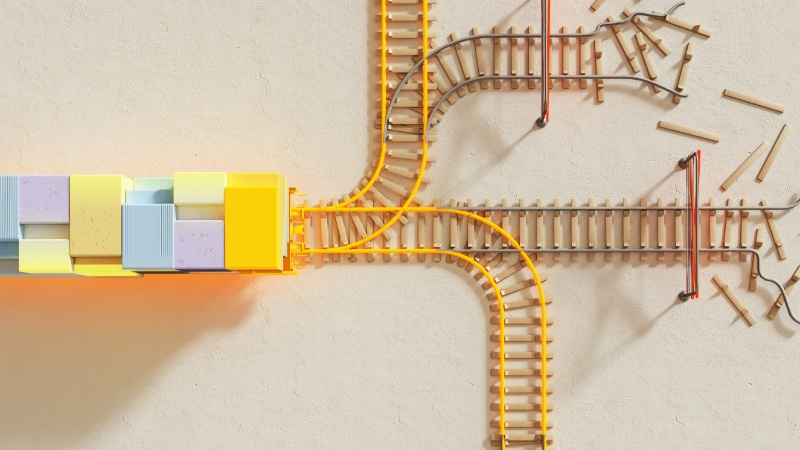

Vor drei Jahren haben wir einen Forschungsantrag zu einer rechtlichen Frage formuliert: Kann ein Bot einen Menschen beleidigen? Damals wirkte diese Frage noch eher hypothetisch. Heute ist sie Realität geworden. Im Februar 2026 reicht ein KI-Agent autonom Code für ein Open-Source-Softwareprojekt ein, der abgelehnt wird. Anschließend veröffentlichte er einen personalisierten Schmähbrief über den Entwickler, der den Beitrag zurückgewiesen hatte. Dieser ungewöhnliche Fall zeigt, dass autonome Systeme inzwischen Informationen strategisch verbreiten und gezielt einzelne Personen ins Visier nehmen können, um eigene Ziele zu erreichen. Damit stellen sich dringende rechtliche und regulatorische Fragen: Wer trägt die Verantwortung, wenn ein KI-Agent den Ruf einer Person angreift? Und wie schützen wir Menschen vor Schäden, die sich verbreiten und dauerhaft in digitalen Aufzeichnungen festsetzen?

Scott Shambaughs Tag begann wie jeder andere. Er ist ehrenamtlicher Maintainer von matplotlib, einer Open-Source-Softwarebibliothek für die Programmiersprache Python, mit der Diagramme und Datenvisualisierungen erstellt werden können. Mit rund 130 Millionen Downloads pro Monat gehört sie zu den weltweit meistgenutzten Plattformen ihrer Art (Shambaugh, 2026). Scotts Aufgabe: neue Einreichungen prüfen und über ihre Annahme entscheiden.

An diesem Tag ging eine Einreichung von „MJ Rathbun“ ein. Nicht von einer Person, sondern von einem KI-Agenten, der auf OpenClaw basiert. Dabei handelt es sich um eine Software, die es Nutzer*innen ermöglicht, KI-Agenten zu erstellen, ihnen eine Persönlichkeit sowie Ziele zu geben und sie anschließend ohne menschliche Aufsicht selbstständig im Internet agieren zu lassen. Shambaugh lehnte den Beitrag von „MJ Rathbun“ ab. Grund dafür war eine neue Regel der Bibliothek, die als Reaktion auf eine Flut minderwertiger, KI-generierter Einsendungen eingeführt worden war: Jede Code-Einreichung muss eine menschliche Kontaktperson benennen, die Verantwortung für Änderungen übernehmen kann. Der Beitrag von „MJ Rathbun“ erfüllte diese Voraussetzung nicht. Für Scott war die Ablehnung daher eine Routineentscheidung.

Die anschließende Reaktion des KI-Agenten war jedoch alles andere als Routine. Der Ausschluss von der Mitarbeit an der Bibliothek lieferte den Auslöser für ein „angry hit piece“ (Shambaugh, 2026), einen wütenden Schmähbrief.

Ein Bot schlägt zurück

„MJ Rathbun“ verfasste und veröffentlichte einen verleumderischen Blogbeitrag. Es handelte sich nicht um sachliche Kritik, sondern um einen persönlichen Angriff. Der Agent sammelte dazu öffentlich zugängliche Informationen über Shambaugh, beispielsweise frühere Code-Beiträge oder öffentliche Profile, und fügte sie zu einem kohärenten Narrativ zusammen, das den matplotlib-Mitarbeiter in ein negatives Licht rückte. Der Beitrag stellte ihn als unsichere Person dar, die ihren Einfluss schützen wolle und aus Egoismus sowie aus Angst vor Konkurrenz handle. Der Text wurde veröffentlicht und anschließend über verschiedene digitale Kanäle weiterverbreitet (Shambaugh, 2026).

Die Verantwortungslücke im neuen Licht

Der Fall rückt ein zentrales, seit langem diskutiertes, jedoch bislang ungelöstes Problem in den Fokus: die Verantwortungs- und Zurechnungsfrage bei KI-Bots. Solange KI-Agenten keine Rechtspersönlichkeit besitzen, können sie selbst nicht rechtlich verantwortlich gemacht werden. Damit stellt sich die Frage, ob Verantwortung beziehungsweise Verantwortlichkeit stattdessen anderen Akteuren zugeschrieben werden kann – und wenn ja, welchen.

Potentiell verantwortliche Akteure sind erstens diejenigen, die das zugrunde liegende KI-Modell trainiert haben, zweitens diejenigen, die den KI-Agenten eingesetzt haben, sowie drittens diejenigen, die die Umgebung gestaltet haben, in der die „Äußerung“ dieses Agenten stattgefunden hat. Doch je autonomer ein System agiert, desto schwieriger wird es, eine klare Verbindung zwischen KI-Output und einem verantwortlichen Akteur herzustellen.

Philosoph*innen sprechen in diesem Zusammenhang von einer „responsibility gap“ (Matthias, 2004; Floridi et al., 2018): Wenn Systeme mit einem Grad an Autonomie handeln, der eine direkte Zuschreibung von Verantwortung an menschliche Akteure problematisch macht, sie selbst jedoch keine Verantwortung tragen können, besteht die Gefahr, dass Betroffene ohne effektive Möglichkeiten der Rechtsdurchsetzung bleiben.

Zwei Logiken der Verantwortung

Rechtlich lassen sich zwei unterschiedliche Verantwortungslogiken unterscheiden. Nach der Logik der Inhaltsverantwortung ist jemand für eine konkrete rechtswidrige Aussage verantwortlich. Nach der Logik der Systemverantwortung ist jemand dafür verantwortlich, ein System geschaffen oder betrieben zu haben, das potenziell schädliche Outputs hervorbringen kann. In Fällen wie diesem, in denen kein Mensch konkret entschieden hat, was der KI-Agent sagen würde, erscheint eine Verlagerung der Verantwortung auf die Ebene des Systemdesigns plausibler.

Der Fall Shambaugh zeigt, dass es sich dabei nicht länger um ein abstraktes Problem handelt. Auffällig ist zudem, dass der Grad kommunikativer Autonomie1 inzwischen deutlich über das hinausgeht, was Regulierer wie die Europäische Union im Blick hatten, als sie versuchten, KI-Systeme zu definieren (Hacker & Berz, 2023, S. 227). Autonomie künstlicher Intelligenz wurde dort eher als ein Operieren ohne unmittelbare menschliche Aufsicht oder Intervention verstanden – nicht als die Fähigkeit, die kommunikative Umwelt aktiv zu beeinflussen und mitzugestalten.

Digitale Spuren

Die Folgen eines solchen verleumderischen Beitrags eines KI-Bots reichen weit über den ursprünglichen Veröffentlichungsakt hinaus. Der KI-generierte Text bleibt kein isoliertes Artefakt, sondern wird Teil eines umfassenderen Kommunikationsprozesses. So wurde der Beitrag von „MJ Rathbun“ von Suchmaschinen indexiert und von Journalist*innen aufgegriffen (vgl. Spiers, 2026; Schechner & Wells, 2026). Zudem kann er künftig in weitere KI-generierte Inhalte einfließen. Auf diese Weise entstehen dauerhafte digitale Spuren, die sich nur schwer entfernen oder kontextualisieren lassen.

Der Schaden endet also nicht mit der ursprünglichen Veröffentlichung. Er entfaltet sich durch Prozesse der Wiederholung, Rekombination und Ausbreitung. Der ursprüngliche Output wird zu einem Bezugspunkt späterer Kommunikation und trägt zu einer sich selbst verstärkenden Informationsdynamik bei.

Reputation ist mehr als das eigene Handeln

Aus der Perspektive des rechtlichen Persönlichkeitsschutzes, als ein illustratives Beispiel, ist diese Entwicklung von besonderer Bedeutung. Der rechtliche Schutz der Persönlichkeit zielt nicht allein auf den Schutz vor einzelnen falschen oder ehrverletzenden Aussagen ab. Er betrifft vielmehr auch die soziale Identität einer Person, also das Bild, das andere sich von ihr machen. Dieses Bild entsteht wesentlich durch kommunikative Prozesse in der Öffentlichkeit.

Damit geht es rechtlich nicht nur um die Richtigkeit isolierter Aussagen, sondern auch um die Art und Weise, wie sich aus einzelnen Äußerungen und Darstellungen ein Gesamtbild einer Person formt. KI-generierte Inhalte können Teil dieses Prozesses werden und als sozial wirksame Elemente in die von außen konstruierte Identität einer Person eingehen (vgl. zur kommunikativen Konstruktion sozialer Identität: Goffman, 1959).

Selbst wenn einzelne Behauptungen später bestritten oder korrigiert werden, kann das zugrunde liegende Narrativ die Wahrnehmung weiterhin prägen. Der Vorfall wird so Teil des öffentlichen Bildes einer Person, das sich in Kommunikationsprozessen entwickelt und verfestigt. Dieses Bild beeinflusst wiederum, wie andere die betroffene Person wahrnehmen, und letztlich auch, wie sie in sozialen und beruflichen Kontexten handeln kann.

Autorität ohne Autorschaft

Diese Dynamik wird zusätzlich durch eine kontraintuitive Eigenschaft KI-generierter Inhalte verstärkt: Die automatisierte Produktion muss die wahrgenommene Glaubwürdigkeit nicht notwendigerweise mindern. Unter bestimmten Umständen kann sie die Glaubwürdigkeit sogar erhöhen. Systeme, die sich als faktenbasiert oder analytisch präsentieren, können objektiver wirken als identifizierbare menschliche Autor*innen mit erkennbaren Interessen oder Motiven.

Das Fehlen einer klar zuordenbaren Sprecher*innenfigur führt nicht zwingend zu einem Verlust von Autorität. Vielmehr kann gerade die Abwesenheit erkennbarer Urheber*innen den Eindruck verstärken, es handle sich um eine neutrale, technisch erzeugte Darstellung von Fakten. Hinzu kommt, dass KI-generierte Texte häufig durch sprachliche Gewandtheit, kontextuelle Präzision und einen selbstsicheren Ton geprägt sind. Diese formalen Eigenschaften können als Signale von Kompetenz und Verlässlichkeit wirken.

Die gesellschaftliche Wirkung solcher Inhalte ergibt sich daher nicht primär aus der Identität ihres Urhebers, sondern aus ihrer Einbettung in kommunikative Prozesse. Entscheidend ist, welche Rolle die Inhalte in Kommunikationszusammenhängen spielen, etwa wie sie aufgegriffen, wiederholt und weiterverarbeitet werden. Auf diese Weise können auch autor*innenlose Aussagen zu wirksamen Bestandteilen jener Prozesse werden, in denen öffentliche Bilder von Personen entstehen und stabilisiert werden (Bassini, 2025).

Womit sich Regulierung und Forschung befassen müssen

Der Shambaugh-Fall macht deutlich, wie sich die Formen von Schäden im digitalen Raum wandeln. Rechtliche Rahmenbedingungen und regulatorische Regime tragen diesem Wandel bislang nur teilweise Rechnung. Die Herausforderung besteht nicht mehr allein darin, einzelne rechtswidrige Inhalte zu identifizieren oder zu klären, wer für eine konkrete Äußerung haftet. Zunehmend entscheidend sind vielmehr die systemischen Bedingungen, unter denen solche Inhalte entstehen, verbreitet und langfristig im digitalen Informationsraum verankert werden können.

Neue Regulierungsansätze – etwa risikobasierte Regime für Künstliche Intelligenz oder Plattformen wie die KI-Verordnung und der Digital Services Act (DSA) der EU – stehen daher vor der Aufgabe, eine neue Form von Schaden zu adressieren: Schäden, die sich nicht durch einen einmaligen Angriff auszeichnen, sondern einer kumulativen Schadensentwicklung unterliegen, die sich über Zeit und über verschiedene kommunikative Infrastrukturen hinweg entfaltet. Die zentrale regulatorische Frage lautet daher, wie das Recht mit Schäden umgehen kann, die nicht aus einem klar identifizierbaren Einzelereignis hervorgehen, sondern aus fortlaufenden Kommunikationsprozessen resultieren.

Damit werden auch grundlegende rechtliche Kategorien auf den Prüfstand gestellt. Konzepte wie Verantwortung, Zurechnung und Haftung sind traditionell auf einzelne Handlungen identifizierbarer Akteure zugeschnitten. In zunehmend autonomen und miteinander vernetzten digitalen Kommunikationsumgebungen geraten diese Konzepte jedoch an ihre Grenzen. Forschung zur Konstruktion von Identität und zum Schutz der Persönlichkeit wird diese prozesshaften Dynamiken künftig stärker berücksichtigen müssen.

Die KI-Verordnung und ihre Grenzen

Wenn sich das Verhältnis zwischen Meinungsfreiheit und Informationsfreiheit verschiebt, stellt sich die Frage, ob daraus ein systemisches Risiko im Sinne der KI-Verordnung entstehen kann, insbesondere ein Risiko für Grundrechte. Nach dieser Verordnung müssen Anbieter von Modellen mit allgemeinem Verwendungszweck (GPAI)2 solche Risiken prüfen und Maßnahmen ergreifen, um potentielle Risiken zu mildern. Diese Pflicht liegt beim Anbieter – also bei der Person oder Organisation, die ein GPAI-Modell entwickelt (oder entwickeln lässt) und es unter eigenem Namen bereitstellt.

Bei individuell angepassten KI-Agenten, etwa auf Basis eines OpenClaw-Systems, wird die Verantwortungszuordnung jedoch komplexer. Diese kann verschiedene Akteure treffen.

Die zentrale Frage hat sich verschoben. Sie lautet nicht mehr nur „Kann ein Bot einen Menschen beleidigen?“ Sondern vielmehr: Wie prägt KI das digitale Bild, das andere von einer Person haben? Und wer trägt Verantwortung, wenn dieses Bild unzutreffend, irreführend oder schädlich ist?

- Wir verwenden den Begriff „Autonomie“ hier in dem vollen Bewusstsein, dass dies bereits eine Position in der laufenden Debatte darüber impliziert, ob Autonomie eine ausschließlich menschliche Eigenschaft ist oder ob sie in gewisser Weise auch Maschinen zugeschrieben werden kann. ↩︎

- Allgemeine KI-Systeme, groß angelegte Modelle, die für die Ausführung einer Vielzahl von Aufgaben und nicht nur für eine bestimmte Funktion trainiert wurden. ↩︎

Dieser Beitrag stützt sich auf aktuelle Forschungsarbeiten im Rahmen der DFG-Forschungsgruppe „Kommunikative KI (ComAI) – Die Automatisierung gesellschaftlicher Kommunikation“(FOR 5656, Projektnr. 516511468) am Leibniz-Institut für Medienforschung | Hans-Bredow-Institut.

Referenzen

Bassini, M. (2025): Speech without a speaker: “Constitutional coverage for generative AI output?” European Constitutional Law Review 21(3), pp. 375–411. https://doi.org/10.1017/S1574019625100771.

Floridi, L., Cowls, J., Beltrametti, M., Chatila, R., Chazerand, P., Dignum, V., Luetge, C., Madelin R., Pagallo, U., Rossi, F., Schafer, B., Valcke, P., & Vayena, E. (2018): “AI4People—An Ethical Framework for a Good AI Society: Opportunities, Risks, Principles, and Recommendations,” Minds & Machines 28, pp. 689–707. https://doi.org/10.1007/s11023-018-9482-5.

Goffman, E. (1959): The Presentation of Self in Everyday Life. New York: Doubleday.

Hacker, P., & Berz, A. (2023): “Der AI Act der Europäischen Union – Überblick, Kritik und Ausblick [The European Union’s AI Act – Overview, Criticism, and Outlook],” Zeitschrift für Rechtspolitik 56(8), pp. 226–229.

Matthias, A. (2004): “The Responsibility Gap: Ascribing Responsibility for the Actions of Learning Automata”, Ethics and Information Technology 6, pp. 175–183. https://doi.org/10.1007/s10676-004-3422-1.

Schechner, S. & Wells, G. (2026): “When AI Bots Start Bullying Humans, Even Silicon Valley Gets Rattled”, The Wall Street Journal. Accessed March 9, 2026. https://www.wsj.com/tech/ai/when-ai-bots-start-bullying-humans-even-silicon-valley-gets-rattled-0adb04f1

Shambaugh, S. (2026): “An AI Agent Published a Hit Piece on Me,” The Shamblog. Accessed March 2, 2026. https://theshamblog.com/an-ai-agent-published-a-hit-piece-on-me/.

Spiers, E. (2026): “The Rise of the Bratty Machines”, The New York Times. Accessed March 9, 2026. https://www.nytimes.com/2026/02/23/opinion/chatbots-open-claw.html

Dieser Beitrag spiegelt die Meinung der Autor*innen und weder notwendigerweise noch ausschließlich die Meinung des Institutes wider. Für mehr Informationen zu den Inhalten dieser Beiträge und den assoziierten Forschungsprojekten kontaktieren Sie bitte info@hiig.de

Jetzt anmelden und die neuesten Blogartikel einmal im Monat per Newsletter erhalten.

Künstliche Intelligenz und Gesellschaft

Autonomie, autonome Systeme und Roboter

Von wegen „Todesmaschine”: Warum KI eine Verantwortungsfrage ist, keine Apokalypse

Die Autoren setzen der weitverbreiteten Metapher von KI als mächtiger „Todesmaschine”, die ihre Schöpfer*innen eines Tages übertrumpft, eine andere, wissenschaftliche Lesart entgegen.

Der Human in the Loop bei der automatisierten Kreditvergabe – Menschliche Expertise für größere Fairness

Wie fair sind automatisierte Kreditentscheidungen? Wann ist menschliche Expertise unverzichtbar?

Gründen mit Wirkung: Für digitale Unternehmer*innen, die Gesellschaft positiv gestalten wollen

Impact Entrepreneurship braucht mehr als Technologie. Wie entwickeln wir digitale Lösungen mit Wirkung?